Mythos. Nowa AI ma być tak niebezpieczna, że Anthropic nie chce jej upublicznić

- Nowy model AI „Mythos” firmy Anthropic ma zdolność wykrywania i potencjalnego wykorzystywania luk w zabezpieczeniach systemów, co wzbudziło obawy o cyberbezpieczeństwo – szczególnie w sektorze finansowym.

- Władze USA, w tym przedstawiciele Rezerwa Federalna i Departamentu Skarbu, ostrzegają, że tego typu narzędzia mogą zwiększyć ryzyko nowych form cyberataków, choć jednocześnie mogą być użyte do wzmacniania zabezpieczeń.

- Model nie jest publicznie dostępny – testują go wybrane organizacje technologiczne i finansowe, a eksperci podkreślają, że większym zagrożeniem w przyszłości może być tzw. samo-ewoluująca AI, działająca bez stałej kontroli człowieka.

Czym jest Mythos i czym grozi nowy model AI firmy Anthropic?

Mythos to nowy zaawansowany model językowy (LLM) opracowany przez firmę Anthropic. Według twórców jest to najpotężniejszy model sztucznej inteligencji, jaki kiedykolwiek stworzyli. Model wyróżnia się zdolnością do automatycznego identyfikowania i potencjalnego wykorzystywania luk w zabezpieczeniach systemów operacyjnych oraz przeglądarek internetowych.

Ten tzw. „wielki model językowy” (ang. Large Language Model, LLM), poza pewnymi wyjątkami na razie „trzymany jest w zamknięciu” przez samą firmę Anthropic, która twierdzi, że jest zbyt groźny by go upublicznić.

Jakie zagrożenia wykrył Mythos w praktyce?

Podczas testów model zidentyfikował tysiące luk w oprogramowaniu korporacyjnym. Do najbardziej znaczących odkryć należy:

- Luka w systemie OpenBSD – uznawanym za jeden z najbezpieczniejszych systemów operacyjnych – niewykryta przez 27 lat. Po zgłoszeniu przez Anthropic została usunięta. Wykrycie luki w OpenBSD to niezaprzeczalny sukces Mythosa

- Przejęcie kontroli nad przeglądarką – model wykazał zdolność do manipulowania przeglądarką w taki sposób, że strona stworzona przez atakującego mogła odczytywać dane z innej witryny, np. serwisu bankowego ofiary.

Dlaczego Mythos wywołał alarm w sektorze finansowym USA?

Wśród dyrektorów generalnych zaproszonych na spotkanie z Fed i Departamentem Skarbu znaleźli się: Jane Fraser z Citigroup Inc., Ted Pick z Morgan Stanley, Brian Moynihan z Bank of America Corp., Charlie Scharf z Wells Fargo & Co. oraz David Solomon z Goldman Sachs Group Inc. – poinformowały te osoby. Celem spotkania było upewnienie się, że instytucje finansowe są świadome zagrożeń związanych z Mythosem i podejmują odpowiednie środki ostrożności. Władze USA uznały nowe modele AI – w szczególności Mythosa – za jedno z największych systemowych zagrożeń dla sektora bankowego.

Przedstawiciele administracji USA mówili, że chcieli upewnić się, iż banki są świadome potencjalnych zagrożeń związanych z nowym modelem sztucznej inteligencji i podejmują stosowne środki ostrożności w celu ochrony swoich systemów. Uważają bowiem możliwość pojawienia się nowego rodzaju cyberataków, związanych z modelem Anthropic, ale także innymi nowymi produktami AI, za jedno z największych zagrożeń dla branży finansowej.

Bliższe szczegóły nagłego szczytu finansistów w Waszyngtonie nie zostały ujawnione. Przedstawiciel Departamentu Skarbu i rzecznik Fed, pytani przez amerykańskie media odmawiali komentarzy. Udział Powella w spotkaniu sygnalizował, że obawa dotyczyła ryzyka systemowego i nie była związana z wcześniejszymi konfliktami Pentagonu z firmą Anthropic, komentowali proszący o anonimowość uczestnicy spotkania.

Kto ma dostęp do Mythosa i na jakich zasadach?

Firma Anthropic twierdzi, że Mythos jest tak potężny, że nie ogół użytkowników nie może w tej chwili mieć do niego dostępu. W trybie „demo”, jako „Claude Mythos Preview", mogli się z nim zapoznać przedstawiciele około czterdziestu wybranych organizacji w ramach projektu Project Glasswing. Wśród nich znalazły się firmy technologiczne (Microsoft, Apple, Google), firma cyberbezpieczeństwa CrowdStrike oraz bank JPMorgan Chase.

W swoich komunikatach Anthropic wskazała na kilka luk w zabezpieczeniach, które system sztucznej inteligencji potrafił zarówno zidentyfikować, jak i potencjalnie wykorzystać podczas testów. Żaden z przykładów nie dotyczył konkretnych instytucji finansowych, ale w jednym przypadku zespół ds. bezpieczeństwa firmy podał, że potrafił przejąć kontrolę nad przeglądarką internetową, tak by strona internetowa utworzona przez hakera mogła odczytywać dane z innej strony internetowej, np. „banku ofiary”.

Jaka jest sytuacja prawna Anthropic w USA?

Anthropic prowadzi spór sądowy z administracją Donalda Trumpa. Departament Obrony uznał firmę za zagrożenie dla łańcucha dostaw technologicznego. Federalny sąd apelacyjny odrzucił wniosek Anthropic o wstrzymanie tej decyzji – sprawa jest jednak nadal w toku. Firma poinformowała, że niezależnie od sporu prawnego prowadziła rozmowy z przedstawicielami władz amerykańskich na temat modelu oraz jego „ofensywnych i defensywnych zdolności cybernetycznych”.

Według nieoficjalnych informacji, amerykańskie agencje federalne po cichu testują zaawansowane narzędzia sztucznej inteligencji firmy Anthropic pomimo zakazu administracji Trumpa. Robi tak m. in. Centrum Standardów i Innowacji AI Departamentu Handlu, oceniając nowy model Mythos. Napisał o tym serwis „Politico”, dodając, że urzędnicy postrzegają możliwości modelu jako potencjalnie kluczowe dla wzmocnienia obrony cybernetycznej, co skłania do cichych wysiłków w celu oceny i wdrożenia go pomimo formalnych ograniczeń.

Także ustawodawcy i personel Kongresu ubiegali się o odprawy dotyczące systemu, co odzwierciedla rosnące obawy, że przeciwnicy Stanów Zjednoczonych mogliby opracować podobne narzędzia. Biały Dom poinformował, że stale współpracuje z firmami AI w celu rozwiązania zagrożeń bezpieczeństwa, także tego narodowego.

Dlaczego Mythos może bardziej pomóc i niż zaszkodzić bankom?

Prezes JPMorgan, Jamie Dimon powiedział już po spotkaniu z przedstawicielami amerykańskiej administracji, że choć narzędzia sztucznej inteligencji mogą w przyszłości pomóc firmom w obronie przed cyberatakami, to w tej chwili raczej zwiększają ich podatność na zagrożenia.

Jego organizacja testuje najnowszy model firmy Anthropic w ramach szerszych działań mających na celu czerpanie korzyści ze sztucznej inteligencji przy jednoczesnej ochronie przed złymi podmiotami wykorzystującymi tę samą technologię. Zapytany przez dziennikarza o Mythosa, Dimon nawiązał do ostrzeżenia firmy Anthropic, że model ten wykrył już tysiące luk w zabezpieczeniach oprogramowania korporacyjnego.

Myślę, że dokładnie zrozumieliście, o co chodzi - powiedział Dimon - To pokazuje, że trzeba usunąć o wiele więcej luk w zabezpieczeniach.

Dimon dodał, że chociaż zaawansowane narzędzia sztucznej inteligencji są ważne, to tradycyjne praktyki w zakresie cyberbezpieczeństwa pozostają niezbędne. „Wiele z tego to kwestia higieny… jak chronisz swoje dane? Jak chronisz swoje sieci, routery, sprzęt, zmieniając hasła?” mówi. „Właściwe wykonanie wszystkich tych czynności znacznie zmniejsza ryzyko”.

Potrzeba nowych narzędzi nie tyle wykrywających, ile naprawiających systemy informatyczne

David Lindner, dyrektor ds. bezpieczeństwa informacji w Contrast Security, powiedział magazynowi „Fortune”, że chociaż Mythos może pomóc w wykryciu niezliczonych problemów, niekoniecznie jest to jego przewaga nad innymi technikami cyberbezpieczeństwa.

Nigdy nie mieliśmy problemu ze znalezieniem luk w zabezpieczeniach. Znajdujemy je codziennie. W rzeczywistości mamy ich całą stertę, której po prostu nie naprawiamy - powiedział - Nie sądzę więc, aby to [powstanie modelu Mythos - przyp. red.] naprawdę coś zmieniało.

Lindner zwrócił uwagę, że słabe punkty generalnie łatwiej jest znaleźć niż naprawić, zauważając, że w poście na blogu firmy Anthropic ogłaszającym premierę Mythosa podano, iż ponad 99 proc. luk w zabezpieczeniach wykrytych przez ten model nie zostało załatanych. Dobrze byłoby więc, mówił ekspert, gdyby powstał model nie tylko wykrywający luki i zagrożenia, ale raczej je skutecznie naprawiający.

Czy ograniczony dostęp do Mythosa to troska o bezpieczeństwo, czy chwyt marketingowy?

Antropic pisze o Mythosie, że jest to „zdecydowanie najpotężniejszy modelem sztucznej inteligencji, jaki kiedykolwiek opracowaliśmy”. Jednak w mediach i w internecie nie brakuje komentarzy, że tworzenie atmosfery niesamowitości i potęgi to swoisty rodzaj marketingu firmy, która ostatecznie zainteresowana jest przede wszystkim przyciągnięciem uwagi i sprzedaniem swojego produktu.

Zwłaszcza, że to wszystko już było. Firmy tworzące LLM-y już nie raz ogłaszały, że ich produkty są zbyt niebezpieczne by je udostępnić. Już model GPT-2 firmy OpenAI w 2019 roku przez jego twórców był określany jako „zbyt groźny”. Jednak jeszcze w tym samym roku został upubliczniony a dziś może nas ta historia śmieszyć, zważywszy porównanie tego starego modelu z późniejszymi wcieleniami AI. Sugestie i komunikaty o „zbyt niebezpiecznych” modelach sztucznej inteligencji pojawiały się potem wielokrotnie. Zwykle okazywało się, że to, co w końcu udostępniono, choć było lepsze niż poprzednie wersje, AI-pokalipsą nie groziło.

Niektórzy doszukują się w tym wszystkim jeszcze innego dna. Znany inwestor z Krzemowej Doliny Marc Andreessen pyta, czy firma Anthropic rzeczywiście wstrzymuje się z udostępnieniem Mythosa ze względu na obawy dotyczące bezpieczeństwa, czy też może tak naprawdę dlatego, że brakuje jej mocy obliczeniowej do wsparcia wdrożenia na masową skalę. Jak donosił „Wall Street Journal”, Anthropic borykała się ostatnio z częstymi awariami i ograniczała użytkownikom dostęp do mocy obliczeniowej w godzinach szczytu. Były sygnały o pogorszeniu się jakości pracy głównych modeli firmy z serii Claude.

Czym jest samo-ewoluująca AI i dlaczego może być groźniejsza od Mythosa?

Być może więc w tym, o czym mówi się w kontekście Mythosa to przesada i specyficzna technika promocji. Zdaniem ekspertów, jeśli już, to bardziej niż modeli AI szkolonych ostatecznie przez ludzi na zamkniętych zbiorach danych należałoby się w tym kontekście obawiać tzw. samo-ewoluującej sztucznej inteligencji (ang. „self-evolving AI”).

Samo-ewoluująca sztuczna inteligencja to systemy zdolne do samodzielnego doskonalenia własnych algorytmów bez bezpośredniej interwencji człowieka. Działają przez:

- analizę własnych błędów i wyników,

- równoległe testowanie wielu konfiguracji,

- autonomiczne wprowadzanie ulepszeń na wzór doboru naturalnego.

Eksperci wskazują, że tego rodzaju systemy, szczególnie te pozbawione mechanizmów nadzoru ludzkiego, stanowią potencjalnie większe zagrożenie niż modele trenowane przez ludzi na zamkniętych zbiorach danych, do których należy też Mythos.

W jaki sposób algorytmy naśladują dobór naturalny?

Koncepcja „self-evolving AI” czerpie inspirację z algorytmów ewolucyjnych, w szczególności genetycznych i naśladuje zasady doboru naturalnego w przyrodzie. Samo-ewoluująca sztuczna inteligencja testuje równolegle wiele konfiguracji, zachowując te, które przynoszą najlepsze efekty a odrzucając rozwiązania mniej optymalne. Przykładem może być model AI, który analizuje historię własnych błędów przy optymalizacji kodu źródłowego, a następnie dostosowuje parametry i eksperymentuje z nowymi podejściami, by sukcesywnie udoskonalać swoje metody pracy.

Projekty budowy samouczących się i samoewoluujących systemów podejmowane są od lat. Ciekawym nowym przykładem jest model firmy MiniMax oznaczony M2.7. Jak głoszą jego twórcy, „autonomicznie rozbudowuje swoje możliwości, naśladując ewolucję biologiczną i optymalizując wydajność przez iteracyjne pętle uczenia”. Oparty jest na tzw. architekturze open-weight (otwartych wag), co w kontekście sztucznej inteligencji oznacza modele, w których twórcy udostępniają publicznie gotowe, wyszkolone parametry (wagi) sieci neuronowej. Do tej kategorii zaliczają się m. in. modele Llama od Meta, Mistral, gpt-oss. Można uruchamiać je lokalnie (czyli np. na własnym pececie, który ma odpowiednio silne jednostki obliczeniowe), co gwarantuje pełną kontrolę nad danymi i bezpieczeństwo.

MiniMax M2.7 może być precyzyjnie dopasowany do specyficznych wymagań różnych branż i projektów, od badań naukowych, przez tworzenie produktów komercyjnych, po wewnętrzne automatyzacje procesów biznesowych.

M2.7 nie wymknie się spod kontroli

Należałoby na koniec uspokoić zaniepokojonych, że samo-ewoluujący model M2.7 nie wymknie się spod kontroli, gdyż należy do systemów określanych jako „human-in-the-loop” (HITL), z człowiekiem – operatorem, definiującym cele i weryfikującym kluczowe decyzje, tak by działania AI pozostały zgodne z oczekiwanymi rezultatami i regułami narzuconymi przez ludzi.

To jednak dotyczy M2.7. Czy powstaną samodzielnie uczące się rozwijające modele bez ludzkiej kontroli a w dodatku dysponujące potęgą obliczeniową, jaka zdaje się mieć Mythos? Na to pytanie nie ma w tej chwili dobrej odpowiedzi.

Źródła:

https://www.cnbc.com/2026/04/14/jamie-dimon-anthropic-mythos-vulnerabilities-cyber-attacks.html

https://fortune.com/2026/04/13/cybersecurity-anthropic-claude-mythos-dario-amodei-tech-ceo/

https://www.youtube.com/watch?v=WpcRm78KOvY

https://platform.minimax.io/docs/guides/models-intro

FAQ: Mythos i inne zagrożenia AI

- Czym jest Mythos? Mythos to najnowszy, zaawansowany model językowy (LLM) firmy Anthropic, opisywany przez jej twórców jako najpotężniejszy model AI, jaki kiedykolwiek stworzyli. Jest zdolny do identyfikowania i potencjalnego wykorzystywania luk w zabezpieczeniach systemów operacyjnych i przeglądarek internetowych.

- Dlaczego Mythos wywołał alarm w środowisku finansowym USA? Sekretarz skarbu Scott Bessent i prezes Fed Jerome Powell zwołali pilne spotkanie z szefami największych amerykańskich banków, ponieważ władze uznały Mythosa za jedno z największych zagrożeń dla cyberbezpieczeństwa sektora finansowego – zarówno jako potencjalne narzędzie ataków, jak i sygnał nowej ery ryzyka systemowego.

- Kto ma dostęp do Mythosa? Anthropic nie udostępnia modelu publicznie. W ramach projektu „Project Glasswing" dostęp w trybie podglądu („Claude Mythos Preview") otrzymało ok. 40 organizacji, m.in. Microsoft, Apple, Google, CrowdStrike i JPMorgan Chase – w celu wzmocnienia własnej infrastruktury bezpieczeństwa.

- Jakie konkretne zagrożenia wykrył Mythos? Model wykrył tysiące luk w oprogramowaniu korporacyjnym, w tym lukę w systemie OpenBSD, która pozostawała niezauważona przez 27 lat. Wykazał też zdolność do przejęcia kontroli nad przeglądarką w taki sposób, że strona hakera mogłaby odczytywać dane np. z serwisu bankowego.

- Czy Mythos może też chronić – a nie tylko atakować? Tak. Banki i instytucje rządowe testują model właśnie w celach defensywnych – jako narzędzie do wykrywania słabych punktów przed tym, zanim zrobią to cyberprzestępcy. Jamie Dimon z JPMorgan podkreślił jednak, że tradycyjna „higiena" cyberbezpieczeństwa nadal pozostaje niezbędna.

- Jaki jest problem z wykrywaniem luk przez Mythosa? Zdaniem ekspertów luki łatwiej jest znajdować niż naprawiać. Ponad 99% luk wykrytych przez Mythosa wciąż pozostaje niezałatanych. Potrzeba modeli, które nie tylko identyfikują problemy, ale potrafią je skutecznie usuwać.

- Czy doniesienia o wyjątkowości Mythosa to nie jest tylko marketing? Część komentatorów tak to ocenia. Firmy AI wielokrotnie już ogłaszały, że ich modele są „zbyt niebezpieczne" do upublicznienia (np. GPT-2 w 2019 r.), a ostatecznie okazywały się bezpieczniejsze niż zapowiadano. Inwestor Marc Andreessen sugeruje, że Anthropic może wstrzymywać premierę nie ze względów bezpieczeństwa, lecz z powodu problemów z mocą obliczeniową.

- Jaki jest status prawny Anthropic w USA? Anthropic toczy batalię sądową z administracją Donalda Trumpa – Pentagon uznał firmę za zagrożenie dla łańcucha dostaw. Federalny sąd apelacyjny odrzucił wniosek Anthropic o wstrzymanie tej decyzji, ale sprawa jest nadal w toku. Paradoksalnie, część agencji federalnych po cichu testuje modele firmy wbrew oficjalnym zakazom.

- Co to jest samo-ewoluująca AI i dlaczego może być groźniejsza od Mythosa? Samo-ewoluująca AI (ang. self-evolving AI) to systemy zdolne do samodzielnego doskonalenia własnych możliwości bez interwencji człowieka – analizują własne błędy, testują konfiguracje i autonomicznie wprowadzają usprawnienia. Eksperci uważają ją za potencjalnie większe zagrożenie niż modele szkolone na zamkniętych zbiorach danych przez ludzi.

- Czy istnieje bezpieczna samo-ewoluująca AI? Tak, są systemy z mechanizmem „human-in-the-loop" (HITL), gdzie człowiek definiuje cele i weryfikuje kluczowe decyzje. Przykładem jest model MiniMax M2.7 oparty na architekturze open-weight. Otwartą kwestią pozostaje jednak to, czy powstaną samo-ewoluujące modele pozbawione takiej kontroli i dysponujące mocą obliczeniową klasy Mythosa.

[Autor, Mirosław Usidus jest popularyzotorem nauki i byłym redaktorem naczelnym Młodego Technika]

[Tytuł, lead, sekcje "Co musisz wiedzieć", "Dlaczego to historyczny moment i niektóre śródtytuły od Redakcji]

Najważniejsze wydarzenia 2026 w Kościele. Wśród nich encyklika Leona XIV o sprawach społecznych i AI

W 2026 r. AI będzie wykorzystywana coraz częściej do oszustw i wyłudzeń. Raport

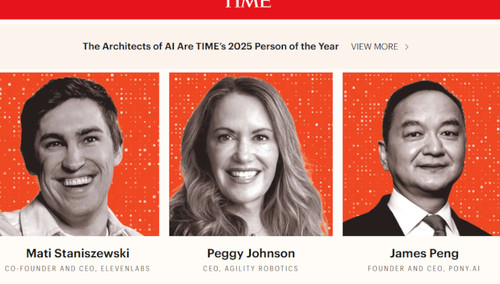

Wiecie, że na liście 100 najbardziej wpływowych osób AI Magazynu TIME jest dwóch Polaków?

Aleksandra Fedorska: Merkel ogłasza wojnę o algorytmy i media cyfrowe z USA

AI nie jest nieomylna. Eksperci apelują o krytyczne myślenie